1.1广义线性模型[GeneralizedLinearModels]

以下是一组方法用于回归的目标价值预计将输入变量的线性组合。在数学概念, y是要预测的值

1.1广义线性模型

下面的公式是一个线性模型。在数学意义上 $ \hat{y} $ 是预测值

$$ \hat{y}(w, x) = w_0 + w_1 x_1 + … + w_p x_p $$

通过这个模型,我把列表w = (w_1,…, wp)指定为`coef把$w_0$指定为intercept_`

普通最小二乘法

线性回归适用线程模型集合w = (w_1,…, w_p)的最小平方差来观察响应数据集和响应数据集的相似性,数据上它的方程式是:

$$ \underset{w}{min\,} {|| X w - y||_2}^2 $$

线性回归会把x,y的数组传送给fit方法同时保存线性模型的w集合在它的coef属性:123456from sklearn import linear_modelclf = linear_model.LinearRegression()clf.fit ([[0, 0], [1, 1], [2, 2]], [0, 1, 2])LinearRegression(copy_X=True, fit_intercept=True, n_jobs=1, normalize=False)clf.coef_array([ 0.5, 0.5])

然而,普通最小二乘估计系数依赖于独立模型的条件。当条件相关,设计矩阵的列有近似线性关系,设计矩阵接近奇异和结果,随机误差的最小二乘估计变得高度敏感的观察到的反应,产生很大差异。这种情况下可能出现多重共线性的,例如,当数据收集没有实验设计。

例如

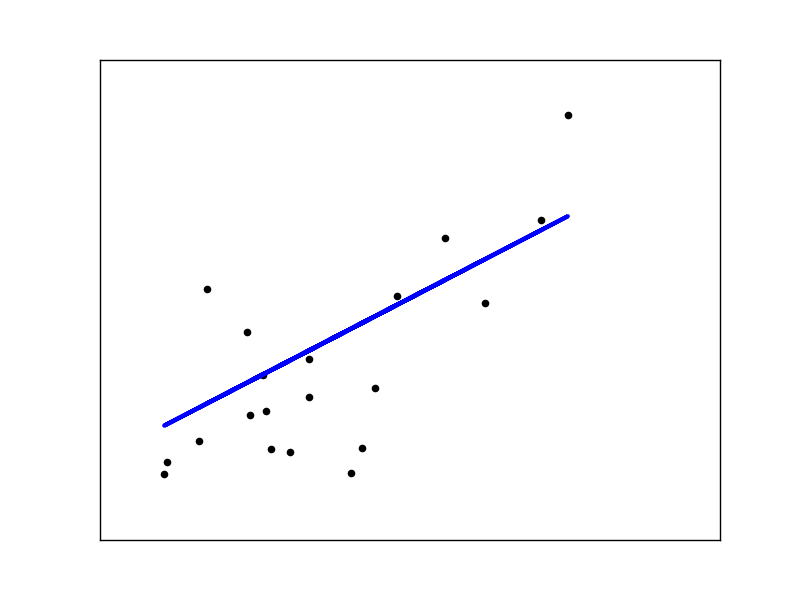

线性回归例子

1.1.1.1 普通最小二乘法的复杂性

这个方法用X的奇值来计算最小二乘数。如果X是一个(n,p)的矩阵,建设n>=p 则这个方法的时间复杂度为$O(n p^2)$